Курсовая работа: Анализ методов определения минимального, максимального значения функции при наличии ограничений

Курсовая работа: Анализ методов определения минимального, максимального значения функции при наличии ограничений

Курсовая работа: Анализ методов определения минимального, максимального значения функции при наличии ограничений

Федеральное агентство по образованию

Московский государственный открытый университет

Чебоксарский политехнический институт

Курсовой проект

по дисциплине: "Оптимальные системы автоматического управления"

на тему: "Анализ методов определения минимального, максимального значения функции при наличии ограничений"

Выполнил:

студент 5 курса,

ФУИТС, гр. И-52/06,

Терсенидис М. Г.

Проверила:

Изосимова Т. А.

Чебоксары – 2010

Задание

Дана несепарабельная квадратичная функция двух переменных:

![]() ,

,

где a = 1, b = 0.5, c = 1, d = 0, e = 1, f = 0.333.

Дана начальная точка поиска A0(x0, y0), где x0 = 0.5, y0 = 2.5.

1. Найти безусловный экстремум функции f(x,y):

· методом наискорейшего спуска;

· методом сопряженных направлений.

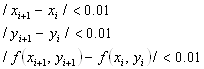

Точность вычислений:

2. Найти условный экстремум этой же функции f(x,y) методом симплексных процедур при наличии ограничений:

1.5x + у – 3.75 ≥ 0;

0.5х + у - 3.75 ≤ 0;

x - у - 2 ≤ 0.

3. Выполнить синтез оптимальной по быстродействию системы с помощью принципа максимума Понтрягина (критерий по быстродействию), передаточная функция объекта:

![]() , где k = 4, T1 = 10, T2 = 5.

, где k = 4, T1 = 10, T2 = 5.

· разработать модель для данного типа ОСАУ;

· провести исследование ОСАУ с применением программного продукта "20-sim Pro 2.3";

· снять переходные и импульсные характеристики.

Содержание

Введение

1. Анализ методов определения минимального и максимального значения функции многих переменных без ограничений

2. Нахождение экстремума функции без ограничения

3. Анализ методов определения минимального, максимального значения функции при наличии ограничений

4. Нахождение экстремума функции при наличии ограничений

5. Синтез оптимальной по быстродействию системы с помощью принципа максимума Понтрягина

Заключение

Список использованной литературы

Приложение

функция переменная экстремум максимум

При решении конкретной задачи оптимизации исследователь прежде всего должен выбрать математический метод, который приводил бы к конечным результатам с наименьшими затратами на вычисления или же давал возможность получить наибольший объем информации об искомом решении. Выбор того или иного метода в значительной степени определяется постановкой оптимальной задачи, а также используемой математической моделью объекта оптимизации.

В настоящее время для решения оптимальных задач применяют в основном следующие методы:

· методы исследования функций классического анализа;

· методы, основанные на использовании неопределенных множителей Лагранжа;

· вариационное исчисление;

· динамическое программирование;

· принцип максимума;

· линейное программирование;

· нелинейное программирование.

Как правило, нельзя рекомендовать какой-либо один метод, который можно использовать для решения всех без исключения задач, возникающих на практике. Одни методы в этом отношении являются более общими, другие - менее общими. Наконец, целую группу методов (методы исследования функций классического анализа, метод множителей Лагранжа, методы нелинейного программирования) на определенных этапах решения оптимальной задачи можно применять в сочетании с другими методами, например динамическим программированием или принципом максимума.

Отметим также, что некоторые методы специально разработаны или наилучшим образом подходят для решения оптимальных задач с математическими моделями определенного вида. Так, математический аппарат линейного программирования, специально создан для решения задач с линейными критериями оптимальности и линейными ограничениями на переменные и позволяет решать большинство задач, сформулированных в такой постановке.

Динамическое программирование хорошо приспособлено для решения задач оптимизации многостадийных процессов, особенно тех, в которых состояние каждой стадии характеризуется относительно небольшим числом переменных состояния.

Пожалуй, наилучшим путем при выборе метода оптимизации, наиболее пригодного для решения соответствующей задачи, следует признать исследование возможностей и опыта применения различных методов оптимизации.

1. Анализ методов определения минимального и максимального значения функции многих переменных без ограничений

В данном разделе будет рассматриваться задача безусловной оптимизации, т.е. данная задача характеризуется тем, что минимум функции f: Rm ® R ищется на всем пространстве: f(x) ® min, x Î Rm.

Методы безусловной оптимизации функции многих переменных отличаются относительно высоким уровнем развития по сравнению с другими методами нелинейного программирования. Условно их можно разбить на три широких класса по типу используемой информации:

· методы прямого поиска, основанные на вычислении только значений целевой функции;

· градиентные методы, в которых используются точные значения первых производных f (x);

· методы второго порядка, в которых наряду с первыми производными используются также вторые производные функции f (x).

Методы прямого поиска

Здесь предполагается, что f(x) непрерывна и унимодальная. Если рассматриваемые методы применяются для анализа мультимодальных функций, то приходится ограничиваться идентификацией локальных минимумов. К особенностям этих методов можно отнести:

· относительная простота соответствующих вычислительных процедур, которые быстро реализуются и легко корректируются;

· не требуют явного выражения целевой функции в аналитическом виде;

· может требовать более значительных затрат времени по сравнению с методами, основанными на производных.

Метод поиска по симплексу

Процедура симплексного метода базируется на регулярном симплексе. Регулярный симплекс в N-мерном пространстве представляет собой многогранник, образованный N+1 равностоящими друг от друга точками - вершинами. Так в задаче с двумя переменными симплексом является равносторонний треугольник, с тремя - тетраэдр.

Работа алгоритма симплексного поиска начинается с построения регулярного симплекса в пространстве независимых переменных и оценивания значений целевой функции в каждой из вершин симплекса. При этом отбрасывается вершина, которой соответствует наибольшее значение целевой функции.

Преимущества метода:

· сравнительная простота логической структуры метода и, соответственно, программы для ЭВМ;

· используется сравнительно небольшое число заранее установленных параметров;

· невысокий уровень требований к ЭВМ;

· алгоритм эффективен даже в тех случаях, когда ошибка вычисления значений целевой функции велика, т.к. при его реализации используют наибольшие значения функции в вершинах, а не меньшие.

Недостатки метода:

· возникает проблема масштабирования, поскольку все координаты вершин симплекса зависят от одного масштабного множителя. Чтобы избежать такого рода проблем в практических задачах, следует промасштабировать все переменные с тем, чтобы их значения были сравнимы по величине;

· алгоритм работает достаточно медленно, т.к. полученная на предыдущих итерациях информация не используется для ускорения поиска;

· не существует простого способа расширения симплекса. Требуется перерасчет значений целевой функции во всех точках образца.

Градиентные методы

Важность прямых методов неоспорима, т.к. в практических задачах информация о значениях целевой функции является единственно надежной информацией, которой располагает инженер. Однако, если существует и непрерывны целевая функция f(x) и ее первые производные, a также они могут быть записаны в аналитическом виде (или с достаточно высокой точностью вычислены при помощи численных методов), то целесообразно использовать методы, основанные на использовании градиента целевой функции.

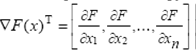

Градиент функции F(x) – это вектор, составляющие которого равны частным производным функции F(x) по соответствующим переменным, т.е.

Направление вектора градиента совпадает с направлением наискорейшего возрастания функции. Вектор противоположного знака -ÑF(x) называется антиградиентом, его направление совпадает с направлением наискорейшего убывания функции.

Матрица вторых производных Ñ2F(x) – это симметричная квадратная матрица порядка n вторых частных производных функции F(x). Эту матрицу называют матрицей Гессе и обозначают H(x) = Ñ2F(x). Ее элемент, расположенный на пересечении i-й строки и j-го столбца, равен:

Пусть хТ=[x1, x2,…, xn] – вектор переменных. Для наличия в точке x* локального минимума (максимума) необходимо, чтобы выполнялось равенство ÑF(x*) =0 и матрица Гессе H(x*) = Ñ2F(x*) была положительно (отрицательно) полуопределенной, т.е. xTHx ³0 ( xTHx £0).

Достаточным условием существования минимума (максимума) в точке x* является положительная (отрицательная) определённость матрицы Гессе в этой точке, т.е. xTHx >0 ( xTHx<0).

Все методы основаны на итерационной процедуре, реализуемой в соответствии с формулой xk+1 = xk + ak s(xk), где

xk - текущее приближение к решению x*;

ak - параметр, характеризующий длину шага;

s(xk) - направление поиска в N - мерном пространстве управляемых переменных xi, i = 1, 2,..., N.

Способ определения ak и s(xk) на каждой итерации связан с особенностями применяемого метода. Обычно выбор ak осуществляется путем решения задачи минимизации f(x) в направлении s(xk). Поэтому при реализации градиентных методов необходимо использовать эффективные алгоритмы одномерной минимизации.

Простейший градиентный метод

В основе метода лежит следующая итерационная модификация формулы

xk+1 = xk + a k s(xk),

xk+1 = xk - a k Ñ f(xk), где

a - заданный положительный коэффициент;

Ñ f(xk) - градиент целевой функции первого порядка.

Недостатки:

· необходимость выбора подходящего значения ;

· медленная сходимость к точке минимума ввиду малости f(xk) в окрестности этой точки.

Метод наискорейшего спуска

Свободен от первого недостатка простейшего градиентного метода, т.к. ak вычисляется путем решения задачи минимизации Ñ f(xk) вдоль направления Ñ f(xk) с помощью одного из методов одномерной оптимизации xk+1 = xk - a k Ñ f(xk).

Данный метод иногда называют методом Коши.

Алгоритм характеризуется низкой скоростью сходимости при решении практических задач. Это объясняется тем, что изменения переменных непосредственно зависит от величины градиента, которая стремится к нулю в окрестности точки минимума и отсутствует механизм ускорения на последних итерациях. Поэтому, учитывая устойчивость алгоритма, метод наискорейшего спуска часто используется как начальная процедура поиска решения (из точек, расположенных на значительных расстояниях от точки минимума).

Метод сопряженных направлений

Общая задача нелинейного программирования без ограничений сводится к следующему: минимизировать f(x), xÎ En, где f(x) является целевой функцией. При решении этой задачи мы используем методы минимизации, которые приводят к стационарной точке f(x), определяемой уравнением Ñf(x*)=0. Метод сопряженных направлений относится к методам минимизации без ограничений, использующим производные. Задача: минимизировать f(x), xÎ En, где f(x) является целевой функцией n независимых переменных. Важной особенностью является быстрая сходимость за счет того, что при выборе направления используется матрица Гессе, которая описывает область топологии поверхности отклика. В частности, если целевая функция квадратичная, то можно получить точку минимума не более чем за количество шагов, равное размерности задачи.

Для применения метода на практике его необходимо дополнить процедурами проверки сходимости и линейной независимости системы направлений. Методы второго порядка

Метод Ньютона

Последовательное применение схемы квадратичной аппроксимации приводит к реализации оптимизационного метода Ньютона по формуле

xk+1 = xk - Ñ2 f(xk-1) Ñ f(xk).

Недостатком метода Ньютона является его недостаточная надежность при оптимизации не квадратичных целевых функций. Поэтому его часто модифицируют:

xk+1 = xk - ak Ñ2 f(xk-1) Ñ f(xk), где

ak - параметр, выбираемый таким образом, чтобы f(xk+1) ® min.

2. Нахождение экстремума функции без ограниченияДана некоторая функция f(х) на открытом интервале (а, в) изменения аргумента х. Предполагаем, что exst внутри этого интервала существует (нужно сказать, что в общем случае математически заранее это утверждать не могут; однако в технических приложениях очень часто наличие exst внутри некоторого интервала изменения интервала изменения аргумента может быть предсказано из физических соображений).

Определение exst. Функция f(x) заданная на интервале (а, в) имеет в точке x* max(min), если эту точку можно окружить таким интервалом (x*-ε, x*+ε), содержащимся в интервале (а, в), что для всех ее точек х, принадлежащих интервалу (x*-ε, x*+ε), выполняется неравенство:

f(x) ≤ f(x*) → для max

f(x) ≥ f(x*) → для min

Это определение не накладывает никаких ограничений на класс функций f(x), что, конечно, очень ценно.

Если ограничится для функций f(x), достаточно распространенным, но все же более узким классом гладких функций (под гладкими функциями мы будем понимать такие функции, которые непрерывны вместе со своими производными на интервале изменения аргумента), то можно воспользоваться теоремой Ферма, которая дает необходимые условия существования exst.

Теорема Ферма. Пусть

функция f(x) определена в некотором интервале (а, в) и в точке "с"

этого интервала принимает наибольшее (наименьшее) значение. Если существует в

этой точке двухсторонняя конечная производная ![]() ,

то существования необходимо exst

,

то существования необходимо exst ![]() .

.

Примечание. Двухсторонняя

производная характеризуется свойством ![]() иными

словами, речь идет о том, что в точке "с" производная в пределе одна и

та же при подходе к точке "с" слева и справа, т.е. f(x) – гладкая функция.

иными

словами, речь идет о том, что в точке "с" производная в пределе одна и

та же при подходе к точке "с" слева и справа, т.е. f(x) – гладкая функция.

*В случае ![]() имеет

место min, а при

имеет

место min, а при ![]() →

max. Наконец, если при х=х0

→

max. Наконец, если при х=х0 ![]() , то использование 2-ой производной

не помогает и нужно воспользоваться, например, определением exst.

, то использование 2-ой производной

не помогает и нужно воспользоваться, например, определением exst.

При решении задачи I необходимые условия exst (т.е. теорема Ферма) используется очень часто.

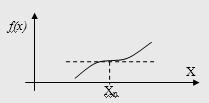

Если уравнение exst ![]() имеет вещественные корни, то точки, соответствующие

этим корням, являются подозрительными на exst (но не обязательно самыми экстремумами, ибо имеем дело с необходимыми,

а не с необходимыми и достаточными условиями). Так, например, в точке перегиба Хп

имеет место

имеет вещественные корни, то точки, соответствующие

этим корням, являются подозрительными на exst (но не обязательно самыми экстремумами, ибо имеем дело с необходимыми,

а не с необходимыми и достаточными условиями). Так, например, в точке перегиба Хп

имеет место ![]() , однако, как

известно, это не экстремум.

, однако, как

известно, это не экстремум.

Заметим ещё, что:

· из необходимых условий нельзя сказать, какой вид экстремума найден max или min: для определения этого нужны дополнительные исследования;