Курсовая работа: Градиентный метод первого порядка

Курсовая работа: Градиентный метод первого порядка

Предложенный план эксперимента обладает следующими свойствами:

Свойство симметричности.

![]() ;

;

Свойство нормировки.

![]() ;

;

Свойство ортогональности.

![]() , ( l

, ( l![]() j , l,i =

1…k );

j , l,i =

1…k );

Следует отметить, что ортогональные планы полный факторный эксперимент ( для линейных моделей ) обладают также рототабельностью. Последнее предполагает равенство и минимальность дисперсий предсказанных значений выходной переменной для всех точек факторного пространства. По закону накопления ошибок для дисперсии предсказанных уравнением регрессии значений выходной переменной можно записать:

s2y= s2b0 + s2b1U12 + … + s2bnUn2

Дисперсии коэффициентов регрессии равны между собою, поэтому

s2y = s2bi![]()

С учетом того, что

![]() ,

,

Где ![]() - радиус сферы имеем

- радиус сферы имеем

s2y = s2

bi![]() .

.

Отсюда ясно, что дисперсия предсказанного значения

выходной переменной зависит только от радиуса сферы. Это свойство

рототабельности эквивалентно независимости дисперсии выходной переменной от

вращения координат в центре плана и оправдано при поиске оптимума градиентными

методами. Интуитивно понятно, что исследователю удобно иметь дело с такой

информацией, содержащейся в уравнении регрессии, которая равномерно «размазана»

по сфере радиусом ![]() . Действительно такое положение

можно признать разумным, ибо с помощью уравнения регрессии будут

предприниматься попытки предсказать положение ещё неизвестных участков

факторного пространства. Равноценность этих участков в смысле ошибки

предсказания, по-видимому, является необходимой.

. Действительно такое положение

можно признать разумным, ибо с помощью уравнения регрессии будут

предприниматься попытки предсказать положение ещё неизвестных участков

факторного пространства. Равноценность этих участков в смысле ошибки

предсказания, по-видимому, является необходимой.

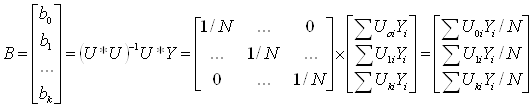

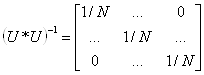

Свойство ортогональности существенно облегчает процесс вычисления коэффициентов, так как корреляционная матрица (UТU)-1 становится диагональной, и коэффициенты будут равны 1/N;

6. С учетом

свойства ортогональности можно вычислить вектор В коэффициентов регрессии:![]()

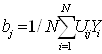

Следовательно, любой коэффициент уравнения регрессии bj определяется скалярным произведением столбца Y на соответствующий столбец Uj, деленным на число опытов N в матрице планирования:

Вычислим коэффициенты регрессии линейного уравнения :

![]()

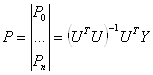

Если в рассмотрение ввести более полное уравнение регрессии с коэффициентами взаимодействия Р, то используя процедуру метода наименьших квадратов , получим:

.

.

Пользуясь планом, представленным в табл. 1.2, можно перечислить коэффициенты регрессии и записать в табл.1.4:

Y = Р0 + Р1U1 + Р2U2 + … + РnUn + … +

+…+ P13U1U3 + P23U2U3 + … + P123U1U2U3…

Таблица 1.4

| Номер опыта |

U0 |

U1 |

U2 |

… |

Un |

… |

|

|

|

… | У |

| 1 | +1 | +1 | +1 | … | +1 |

… |

-1 | +1 | +1 |

… |

У1 |

| 2 | +1 | -1 | +1 | … | +1 |

… |

-1 | -1 | +1 |

… |

У2 |

| … | … | … | … | … | … | … | … | … | … | … | … |

| N | +1 | -1 | -1 | … | -1 |

… |

-1 | +1 | +1 |

… |

УN |

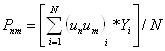

P12, P23 - эффекты двойного взаимодействия, а P123 - эффекты тройного взаимодействия. Эффекты взаимодействия определяют аналогично линейным эффектам:

.

.

7. Проверка однородности дисперсии и значимости коэффициентов регрессии.

Если дополнительно поставить параллельные опыты, можно определить s2воспр - дисперсию воспроизводимости, проверить значимость коэффициентов регрессии, а при наличии степеней свободы – адекватность уравнения.

В связи с тем, что корреляционная матрица (U*U)-1 для спланированного эксперимента есть матрица диагональная

,

,

коэффициенты уравнения регрессии некоррелированы между

собой. Значимость коэффициентов уравнения регрессии можно проверять для каждого

коэффициента в отдельности, пользуясь критерием Стьюдента : ![]() . Исключение из

уравнения регрессии незначимого коэффициента не скажется на значениях остальных

коэффициентов. При этом выборочные коэффициенты bj

оказываются так называемыми несмешанными оценками для соответствующих

генеральных коэффициентов βj:

. Исключение из

уравнения регрессии незначимого коэффициента не скажется на значениях остальных

коэффициентов. При этом выборочные коэффициенты bj

оказываются так называемыми несмешанными оценками для соответствующих

генеральных коэффициентов βj:

bj![]() βj, т. е. величины коэффициентов уравнения регрессии характеризуют вклад

каждого фактора в величину y.

βj, т. е. величины коэффициентов уравнения регрессии характеризуют вклад

каждого фактора в величину y.

Диагональные элементы корреляционной матрицы равны между собой, поэтому все коэффициенты уравнений

Y = ![]() и Y = Р0

+ Р1U1 + Р2U2 + … + РnUn + … +

и Y = Р0

+ Р1U1 + Р2U2 + … + РnUn + … +

+ … + ![]()

oпределяются с одинаковой точностью:

s bj= s2воспр![]()

8. Проверка адекватности уравнения

Проверка адекватности уравнения проводится по критерию Фишера:

Рассчитывается значение

F= s2ост/ s2воспр ; s2ост ![]() ,

,

где m - число значимых коэффициентов в уравнении регрессии.

2. После проведения полного факторного эксперимента определены коэффициенты регрессии

![]()

Тогда

частные производные будут пропорциональны ![]() .

.

3. Делая, с учетом последнего выражения,

шаг в сторону, противоположную среднему, определяем новую точку ![]() и опять

проводим эксперимент.

и опять

проводим эксперимент.

4. Повторяем первые три шага, пока не приблизимся к точке экстремума. При приближении к точке экстремума алгоритм начинает работать плохо при близости к нулю частных производных, то есть линейная модель становится неадекватной и требует введения квадратичных членов.

Страницы: 1, 2, 3, 4, 5, 6, 7, 8, 9